Isolamento vertical/imunidade de grupo: salvação da economia?

Enviado: Qui, 26 Março 2020 - 23:50 pm

A política de coronavírus do Reino Unido pode parecer científica. Não é

Dominic Cummings adora teorizar sobre a complexidade, mas ele está entendendo tudo errado

Quando, juntamente com o cientista de sistemas aplicados Dr Joe Norman, nós reagimos primeiramente ao coronavírus em 25 de janeiro, com a publicação de uma nota pedindo cautela acadêmica, o vírus tinha supostamente infectado menos de 2.000 pessoas no mundo e menos de 60 pessoas morreram. Esse número não precisa ter sido tão alto.

No momento da redação deste artigo, os números são 351.000 e 15.000, respectivamente. Nossa pesquisa não usou nenhum modelo complicado com um grande número de variáveis, assim como não mais que alguém que vê uma avalanche indo em sua direção exige modelos estatísticos complicados para ver se ele precisa sair do caminho.

Pedimos um exercício simples do princípio da precaução em um domínio em que ele importava: sistemas complexos interconectados têm alguns atributos que permitem que algumas coisas fujam do controle, gerando resultados extremos. Adote medidas robustas que seriam, na época, de pequeno custo: restringir a mobilidade. Imediatamente. Mais tarde, invocamos um rápido investimento em preparação: exames, capacidade hospitalar, meios para tratar pacientes. Apenas no caso, você sabe. As coisas podem acontecer.

O erro no Reino Unido está em dois níveis. Modelagem e formulação de políticas.

Primeiro, no nível da modelagem, o governo confiou em todos os estágios em modelos epidemiológicos que foram projetados para nos mostrar aproximadamente o que acontece quando um conjunto pré-selecionado de ações é realizado, e não o que devemos fazer acontecer e como.

Os modeladores usam hipóteses / suposições, que depois alimentam modelos, e usam para tirar conclusões e fazer recomendações de políticas. Criticamente, eles não produzem uma taxa de erro. E se essas suposições estiverem erradas? Eles foram testados? A resposta é frequentemente não. Para trabalhos acadêmicos, isso é bom. Teorias defeituosas podem provocar discussões. O gerenciamento de riscos - como a sabedoria - requer robustez nos modelos.

Mas se basearmos nossos planos de resposta a pandemia em modelos acadêmicos defeituosos, as pessoas morrem. E elas se vão.

Foi o caso da desastrosa tese de "imunidade de grupo" (herd immunity). A idéia por trás da imunidade de grupo era que o surto pararia se um número suficiente de pessoas adoecesse e ganhasse imunidade. Uma vez que uma massa crítica de jovens ganhasse imunidade, disseram os modeladores epidemiológicos, as populações vulneráveis (idosos e doentes) seriam protegidas. Obviamente, essa idéia nada mais era do que uma versão mais sofisticada da abordagem "simplesmente não faça nada".

Indivíduos e cientistas de todo o mundo apontaram imediatamente as falhas óbvias: não há como garantir que apenas os jovens sejam infectados; você precisa de 60 a 70% da população para ser infectado e se recuperar para ter uma chance de imunidade de grupo, e não existem muitas pessoas jovens e saudáveis no Reino Unido ou em qualquer outro lugar. Além disso, muitos jovens têm casos graves da doença, sobrecarregando os sistemas de saúde e um número não tão pequeno deles morre. Não é um almoço grátis.

Isso não inclui mesmo a possibilidade, já suspeitada em alguns casos, de recorrência da doença . A imunidade pode nem ser confiável para esse vírus.

Pior, não levou em consideração que a duração da hospitalização pode ser mais longa do que eles pensam, ou que pode haver uma escassez de leitos hospitalares .

Segundo, mas mais grave, é a formulação de políticas. Parece-se estar apaixonado por "cientificismo" - coisas que têm os atributos cosméticos da ciência, mas sem seu rigor. Isso se manifesta no "grupo do empurrãozinho" (nudge group) que se envolve em experiências com cidadãos do Reino Unido ou na aplicação de métodos da economia comportamental que não funcionam fora da universidade - mas apadrinha os cidadãos como um insulto à sabedoria ancestral e ao aparato de percepção de risco. A ciência social está em uma "crise de replicação", na qual menos da metade dos resultados é replicada (exatamente nas mesmas condições), menos de um décimo pode ser levado a sério e menos de um centésimo é traduzido para o mundo real.

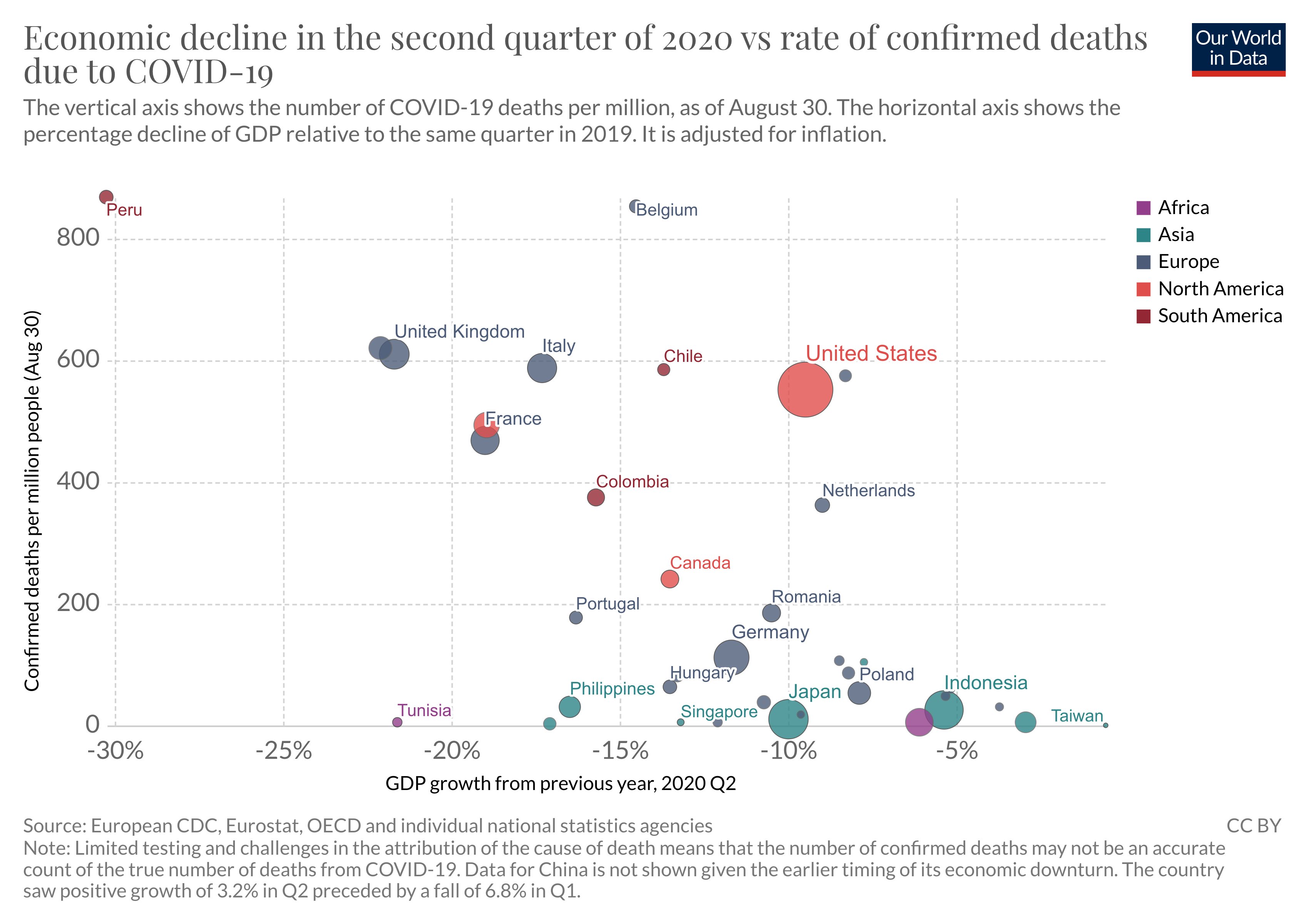

Portanto, o que é chamado de métodos "baseados em evidências" têm um histórico péssimo e praticamente livre de evidências. Esse cientificismo também se manifesta no amor de complexidade e sistemas complexos (nossa especialidade) pelo conselheiro-chefe de Boris Johnson, Dominic Cummings, que ele parece aplicar incorretamente. E deixar um segmento da população morrer pelo bem da economia é uma dicotomia falsa - além da repugnância moral da ideia.

Como dissemos, quando se lida com profunda incerteza, tanto a governança quanto a precaução exigem que se proteja do pior. Embora a assunção de riscos seja um negócio que é deixado para os indivíduos, a segurança coletiva e o risco sistêmico são os negócios do estado. Falhar nesse mandato de prudência, jogando com a vida dos cidadãos, é um erro profissional que se estende além do erro acadêmico; é uma violação da ética do governo.

A política óbvia que resta agora é um bloqueio (lockdown), com testes hiperativos e rastreamento de contatos: siga as evidências da China e da Coréia do Sul em vez de milhares de códigos de computador propensos a erros. Portanto, perdemos semanas, e aqueles que se preocupam com uma ameaça multiplicativa.

• Nassim Nicholas Taleb é um ilustre professor de engenharia de risco na Tandon School of Engineering da Universidade de Nova York e autor de The Black Swan. Yaneer Bar-Yam é presidente do New England Complex System Institute

Fonte: https://www.theguardian.com/commentisfr ... c-cummings (artigo traduzido do inglês para o português)

Dominic Cummings adora teorizar sobre a complexidade, mas ele está entendendo tudo errado

Quando, juntamente com o cientista de sistemas aplicados Dr Joe Norman, nós reagimos primeiramente ao coronavírus em 25 de janeiro, com a publicação de uma nota pedindo cautela acadêmica, o vírus tinha supostamente infectado menos de 2.000 pessoas no mundo e menos de 60 pessoas morreram. Esse número não precisa ter sido tão alto.

No momento da redação deste artigo, os números são 351.000 e 15.000, respectivamente. Nossa pesquisa não usou nenhum modelo complicado com um grande número de variáveis, assim como não mais que alguém que vê uma avalanche indo em sua direção exige modelos estatísticos complicados para ver se ele precisa sair do caminho.

Pedimos um exercício simples do princípio da precaução em um domínio em que ele importava: sistemas complexos interconectados têm alguns atributos que permitem que algumas coisas fujam do controle, gerando resultados extremos. Adote medidas robustas que seriam, na época, de pequeno custo: restringir a mobilidade. Imediatamente. Mais tarde, invocamos um rápido investimento em preparação: exames, capacidade hospitalar, meios para tratar pacientes. Apenas no caso, você sabe. As coisas podem acontecer.

O erro no Reino Unido está em dois níveis. Modelagem e formulação de políticas.

Primeiro, no nível da modelagem, o governo confiou em todos os estágios em modelos epidemiológicos que foram projetados para nos mostrar aproximadamente o que acontece quando um conjunto pré-selecionado de ações é realizado, e não o que devemos fazer acontecer e como.

Os modeladores usam hipóteses / suposições, que depois alimentam modelos, e usam para tirar conclusões e fazer recomendações de políticas. Criticamente, eles não produzem uma taxa de erro. E se essas suposições estiverem erradas? Eles foram testados? A resposta é frequentemente não. Para trabalhos acadêmicos, isso é bom. Teorias defeituosas podem provocar discussões. O gerenciamento de riscos - como a sabedoria - requer robustez nos modelos.

Mas se basearmos nossos planos de resposta a pandemia em modelos acadêmicos defeituosos, as pessoas morrem. E elas se vão.

Foi o caso da desastrosa tese de "imunidade de grupo" (herd immunity). A idéia por trás da imunidade de grupo era que o surto pararia se um número suficiente de pessoas adoecesse e ganhasse imunidade. Uma vez que uma massa crítica de jovens ganhasse imunidade, disseram os modeladores epidemiológicos, as populações vulneráveis (idosos e doentes) seriam protegidas. Obviamente, essa idéia nada mais era do que uma versão mais sofisticada da abordagem "simplesmente não faça nada".

Indivíduos e cientistas de todo o mundo apontaram imediatamente as falhas óbvias: não há como garantir que apenas os jovens sejam infectados; você precisa de 60 a 70% da população para ser infectado e se recuperar para ter uma chance de imunidade de grupo, e não existem muitas pessoas jovens e saudáveis no Reino Unido ou em qualquer outro lugar. Além disso, muitos jovens têm casos graves da doença, sobrecarregando os sistemas de saúde e um número não tão pequeno deles morre. Não é um almoço grátis.

Isso não inclui mesmo a possibilidade, já suspeitada em alguns casos, de recorrência da doença . A imunidade pode nem ser confiável para esse vírus.

Pior, não levou em consideração que a duração da hospitalização pode ser mais longa do que eles pensam, ou que pode haver uma escassez de leitos hospitalares .

Segundo, mas mais grave, é a formulação de políticas. Parece-se estar apaixonado por "cientificismo" - coisas que têm os atributos cosméticos da ciência, mas sem seu rigor. Isso se manifesta no "grupo do empurrãozinho" (nudge group) que se envolve em experiências com cidadãos do Reino Unido ou na aplicação de métodos da economia comportamental que não funcionam fora da universidade - mas apadrinha os cidadãos como um insulto à sabedoria ancestral e ao aparato de percepção de risco. A ciência social está em uma "crise de replicação", na qual menos da metade dos resultados é replicada (exatamente nas mesmas condições), menos de um décimo pode ser levado a sério e menos de um centésimo é traduzido para o mundo real.

Portanto, o que é chamado de métodos "baseados em evidências" têm um histórico péssimo e praticamente livre de evidências. Esse cientificismo também se manifesta no amor de complexidade e sistemas complexos (nossa especialidade) pelo conselheiro-chefe de Boris Johnson, Dominic Cummings, que ele parece aplicar incorretamente. E deixar um segmento da população morrer pelo bem da economia é uma dicotomia falsa - além da repugnância moral da ideia.

Como dissemos, quando se lida com profunda incerteza, tanto a governança quanto a precaução exigem que se proteja do pior. Embora a assunção de riscos seja um negócio que é deixado para os indivíduos, a segurança coletiva e o risco sistêmico são os negócios do estado. Falhar nesse mandato de prudência, jogando com a vida dos cidadãos, é um erro profissional que se estende além do erro acadêmico; é uma violação da ética do governo.

A política óbvia que resta agora é um bloqueio (lockdown), com testes hiperativos e rastreamento de contatos: siga as evidências da China e da Coréia do Sul em vez de milhares de códigos de computador propensos a erros. Portanto, perdemos semanas, e aqueles que se preocupam com uma ameaça multiplicativa.

• Nassim Nicholas Taleb é um ilustre professor de engenharia de risco na Tandon School of Engineering da Universidade de Nova York e autor de The Black Swan. Yaneer Bar-Yam é presidente do New England Complex System Institute

Fonte: https://www.theguardian.com/commentisfr ... c-cummings (artigo traduzido do inglês para o português)